摘要

- 媒体报道|经济学人:No PhD, No Problem | 20181025

- 媒体报道|经济学人:译者的悲伤 | 20170527

- 媒体报道|经济学人:计算机如何学习人类语言?| 20170111

人物摘要

- 杰里米·霍华德(Jeremy Howard):数据科学家,Fast.ai 创始人

- 雷切尔·托马斯(Rachel Thomas):数学家,Fast.ai 创始人

- Andrei Karpathy:director of artificial intelligence and Autopilot Vision at Tesla

- 吴恩达( Andrew Ng ): 斯坦福/百度/deeplearning.ai

经济学人:人人都能构建智能软件

日期:2017年10月25日

标题:No PhD, No Problem

副标:New schemes teach the masses to build AI Treating it like a craft is paying dividends

来源:https://www.economist.com/business/2018/10/25/new-schemes-teach-the-masses-to-build-ai

在过去的五年中,人工智能研究人员已经成为科技界的摇滚明星。深度学习(deep learning)是人工智能(artificial intelligence,AI)领域的一个分支 —— 基于神经网络探索大数据以实现模式识别能力。熟练掌握该方法构建软件的从业者可以在业界获得高达六位数的薪酬,包括亚马逊,苹果,Facebook 和谷歌等科技巨头。顶级专家年薪超过 100 万美元。

过去,进入人工智能领域的标准途径是从一所美国精英大学获得计算机科学博士学位。获得一个需要多年经验、并且适合学术界的职位,这些对于普通民众而言难以企及。研究生通常被有利可图的工作所吸引。

常识正在发生变化。今年十月,Fast.ai (一家位于旧金山的非盈利性教育机构)发布深度学习课程已经三周年。Fast.ai 自成立以来吸引了超过 10 万名学生,学生来源分布在全球各地,从印度到尼日利亚。与其他类似的课程一样,它们都有一个简单的主张:没有必要花费数年时间获得博士学位以实践深度学习。构建智能软件可以作为一种手艺来教学,而不是仅仅在象牙塔中进行的高智力游戏。 Fast.ai 的课程可在短短七周内完成。

数据科学家杰里米·霍华德(Jeremy Howard)与数学家雷切尔·托马斯(Rachel Thomas)一起创立 Fast.ai,他的目标是为了让任何想要知道如何构建智能软件的人都能够获得学习机会。他说学校的数学就足够了。

Fast.ai 初见成效。Sara Hooker 之前从未从事过深度学习,在 Fast.ai 完成课程后毕业的第一年就被竞争激烈的 Google AI Residency Program 雇佣(2015 年创建,旨在培训和支持下一代深度学习研究人员)。她现在是位于加纳首都阿克拉的人工智能研究办公室的创始成员,该办事处是 Google 在非洲的第一家智能研究机构。在班加罗尔,约有 2,400 人是 ai Saturdays 的成员,他们作为一个巨大的研究小组一起跟随课程学习。Andrei Karpathy (特斯拉自动驾驶仪视觉总监)是深度学习的最重要的从业者之一,他同样推荐这门课程。

Fast.ai 不是唯一的替代方案。 ai4all 是另一家非营利性企业,致力于为美国学童提供 AI 教育。吴恩达( Andrew Ng )是该领域的另一位知名人物(斯坦福大学计算机科学系和电气工程系副教授,斯坦福人工智能实验室主任,百度公司原首席科学家),他已经建立了自己的在线学习课程项目 deeplearning.ai 。

霍华德先生的雄心壮志远远超过畅通 AI 劳动力市场。他的目标是将深度学习方法传播到大众手中,以便该方法可以被尽可能多样化的人群应用于各种各样的领域。到目前为止,深度学习几乎由少数年轻的白人控制,几乎所有白人都受雇于科技巨头公司。霍华德先生雄心勃勃地表示,他的目标是让基于人工智能的软件变得像在智能手机上发送电子邮件一样易于使用、无处不在。

一些专家对此表示担忧。很有可能因此建造大量不可靠的人工智能系统,这些系统在理想的情况下是无用的,在最坏的情况下是危险的。回顾科技史可以消除这些担忧。在互联网早期阶段,只有少数具有特定技能的爱好者才能构建应用程序,同时也没有多少人使用这些应用程序。随后,万维网的发明导致了网页数量的爆炸式增长,且无论它们是好是坏。但是,只有开放的互联网才能实现在线购物、全球即时通信和搜索。如果霍华德先生和其他人能够找到他们的成功之路,将人工智能软件的开发变得更容易,就能给世界带来一种新的、不同以往的选择。

经济学人:计算机如何学习人类语言?

日期:2017年1月11日

标题:How machines learned to speak human language

副标:And what does that mean for the way people use computers?

来源:[http://www.economist.com/blogs/economist-explains/2017/01/economist-explains-6]

今年圣诞节数以百万计的人将得到一种装有电子设备的盒子——能够快速地提高使用人类语言的能力。亚马逊的 Echo 设备,配备了一个名为 Alexa 的数字助理,现在在500多万户家庭中出现。 Echo 是一个圆筒形的台式电脑,除了声音之外没有其它接口。你可以要求 Alexa 播报天气信息,播放音乐,预定出租车,告知通勤路程或讲一个老掉牙的笑话,它都会响应。来自美国电脑巨头的语音驱动式数字助理(谷歌的 Assistant、微软的 Cortana和苹果的 Siri)也已经取得了很大的进步。计算机是如何处理人类语言的问题呢?

曾经的想法是将教机器学习语言规则,例如翻译,使用一套语法规则来打破源语言的意义,再用另一组用来重现目标语言中的意思。但是经历过20世纪50年代的乐观情绪过后,业界发现这种系统不能用于复杂的新句子;基于语言规则的方法很难大规模扩展应用。用于人类语言识别技术的研究投资进入了长达几十年的蛰伏期,直到20世纪80年代的迎来复兴时期。[注:著名人工智能专家明斯基(达特茅斯会议的发起者之一)对美国科技决策部分产生了重大影响,自然科学基金会等对传统的自然语言处理研究资助大大减少。弗里德里克-贾里尼克(Frederick Jelinek)及其领导的 IBM 华生实验室(T.J.Watson) 在统计语言学取得关键突破。]

实际上,人类语言识别技术可以通过模式匹配的形式来自我学习。例如语音识别,计算机一边输入语音文件作为语料,另一边是人工编辑的译本作为的译本。系统学着预测这些语音的结果“听起来”应该属于那个译本。在翻译过程中,训练数据是源语言文本和人工翻译的文本。系统自主学习、匹配它们之间的模式。提高语音识别和翻译能力的一个因素是“语言模型”—— 一个关于英语句子的知识库。这大大缩小了系统的预测工作量。

最近有三件事使这种方法取得了巨大的飞跃:首先,计算机的运算能力比过去强大得多。第二,它们可以从海量的、日益增长的数据中学习,不管是在因特网上公开获取还是公司私下收集的。第三,所谓的“深度学习”(deep learning),它使用包括多层次的数字“神经元”及其连接的数字神经网络,使得该系统非常善于从例子中学习。

所有这一切都意味着,计算机现在非常善于回答具备明确定义的问题。例如 “明天伦敦的气温是多少?” (公平地说,你不必是一台电脑也能知道明天伦敦会下雨)。用户甚至可以用更自然的方式询问,比如“明天我应该带伞去伦敦吗?”(数字助理不断地从人们不同的提问方式中学习),但是问一个开放式的问题(“明天伦敦有什么有趣或者可以薅羊毛的事情吗?”)通常你只会得到一个来自搜索引擎结果的列表。

随着机器学习( machine learning)的改进,当用户的智能设备更加熟悉他们时,这样的答案将变得更加有用。这意味着隐私倡导者的麻烦,但是参考过去几年手机应用的情况来看,消费者将作出权衡,他们通常非常高兴能获得新功能。

经济学人:译者为何忧虑?

日期:2017年5月27日

译者:LynnTra@经济学人翻译社

链接:http://www.jianshu.com/p/368f14a1e5b6

來源:https://www.economist.com/news/books-and-arts/21722609-profession-under-pressure-why-translators-have-blues

翻译(本文仅指笔译)可以是一份孤独的工作,这就很好地解释了为什么大多数翻译选择这项职业是出于自身兴趣,而不是关注度。不久之前,可以说一名合格译员都可以谋得一个稳定体面的生活,但是翻译行业正经历着扭曲的变革,让胆小者感受到谋生之艰。

大多数翻译都是自由职业者,随着因特网的普及,一名合格译员可以入住在肯塔基州但服务于瑞士银行。但是网络互通也导致了激烈的全球竞争,随之即是大幅压价。译员们要么拼命多做或者抢酬劳高的活-这意味着实际翻译的时间少了-要么找一家能帮他们争取到任务的代理机构,但这意味着佣金抽取。除了自己单干或者和代理机构合作,译员还可以在线上市场宣传自身技能,但这暴露了最残忍的竞价压力:像译文千字 13-15 美金这么低的价格也不是没有。以前50美金左右就算低价翻译,那时候文学翻译大概是120美金,高价是250美金。在线上市场,几乎不懂外文和译文质量的买家几乎单纯按价格进行买卖。

职业压力还有另外一个出处:较高质量的机器翻译的涌现。仅仅是一年前,机器翻译的结果还不可靠:内容上不准确,且常不具可读性。而如今这两个缺陷都由基于所谓深度神经网络的翻译引擎大幅改善。几乎可以确定那些报特低价的译员们使用了翻译软件,然后直接针对译文的准确度和可读性进行快速编辑。总体来看,大的翻译机构都对这些科技和其广阔可能性拍手叫好。但是,另译员们本身感受担忧的是,自己的未来除了这种科技大清洗,智力上的愉悦感,别无其它了。对于所有现役译员来说,受影响者都不开心。为了避免成为“未来捡咖啡豆的人”,老译员建议提高专业领域知识和写作技能,以争取高端翻译。但并非人人都能做到。身在普遍性和中端市场的翻译们必然更多的是做编辑工作,否则就是被挤出局。

那剩下的翻译们何去何从呢?其一,文学翻译不受威胁。2001至2015年间,在英国,经翻译的小说售量上升了600%还不止,在美国也一直处于强劲增长中。像埃莱娜·费兰特(Elena Ferrante)这样的大作家也建议这些国家的读者们跳出自己的国度找好书。没人会相信一部机器可以翻译出一本小说。罗伊.雅各布森(Roy Jacobsen)的《看不见的事物》(Unseen)被列入2017年布克国际文学奖(Man Booker International Prize-MBIP)决选名单,原本的挪威岛方言经由唐.巴特利特(Don Bartlett)和唐.肖(Don Shaw)地道译出了带有同样风味的英文:“Hvur bitty it is!”(“How small it is!”“这个真是太小了!”)。MBIP让本书原作者和译者共享奖金,认可了翻译事实上是一种创作。

大多数翻译属于商业翻译,但那也属于一种创作。高管们常常否定一份讲稿或者一封信件的译文,因为那看起来不像他们的原作。但是一名好译员需要再度思考文章本身、重述重要篇章、分解或合并句段,如此等等。翻译软件可以做到准确,但它是逐句翻译。由于语言在考量句子好坏时基于不同的节奏、有不同的期待,因此软件效果可能是一团糟。所以翻译最好的办法只能是先思考原语所指深意,再重新创作。

另一个市场就是“译创”(transcreation),常见于广告业,这里要求译员重新思考一条信息,确保它在新语言(译语)中的版本具备正确的文化参照、笑点等诸如此类,来复刻原语的影响力,跳出语言本身。在这种情况下,“译创员”相比大多数译员来说,更是一名原创作者。

正在被科技重塑的翻译工作很难是一项孤独的工作了。法律、会计以及其它很多可敬的工作正见证着重复性脑力工作由机器完成,效果差强人意。未来的翻译想要做得真好,需要的不仅仅是语言和写作技能,还必须获得客户信任、站在客户角度考虑,就像律所或者会计所的合伙人。换句话说,翻译行业里的孤独者可能举步维艰了。

扩展阅读

《The Machine Learning Master》

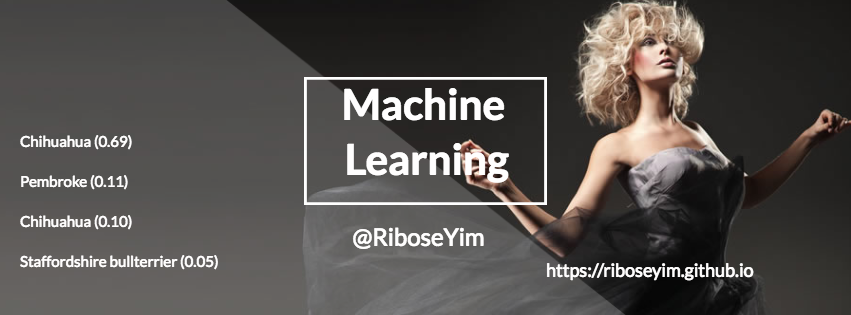

- Machine Learning(一):基于 TensorFlow 实现宠物血统智能识别

- Machine Learning(二):宠物智能识别之 Using OpenCV with Node.js

- Machine Learning:机器学习项目

- Machine Learning:机器学习算法

- Machine Learning:如何选择机器学习算法

- Machine Learning:神经网络基础

- Machine Learning:机器学习书单

- Machine Learning:人工智能媒体报道集

- Machine Learning:机器学习技术与知识产权法

- Machine Learning:经济学家谈人工智能

- 数据可视化(三)基于 Graphviz 实现程序化绘图